Từ khi nhiếp ảnh xuất hiện, con người đã biết chỉnh sửa hay làm giả. Ngày nay, chỉ cần vài dòng lệnh, các công cụ AI đã cho ra đời bức ảnh khó phân biệt thật giả trong chớp mắt.

Sự phát triển nhanh chóng của AI là hồi chuông báo động về việc công nghệ dùng để “lừa” người đang tiến xa hơn công nghệ dùng để giúp người. Các hãng công nghệ, nhà nghiên cứu, hãng ảnh, thông tấn toàn cầu đang nỗ lực để bắt kịp AI và cố gắng đặt ra tiêu chuẩn đối với nguồn gốc, quyền sở hữu nội dung.

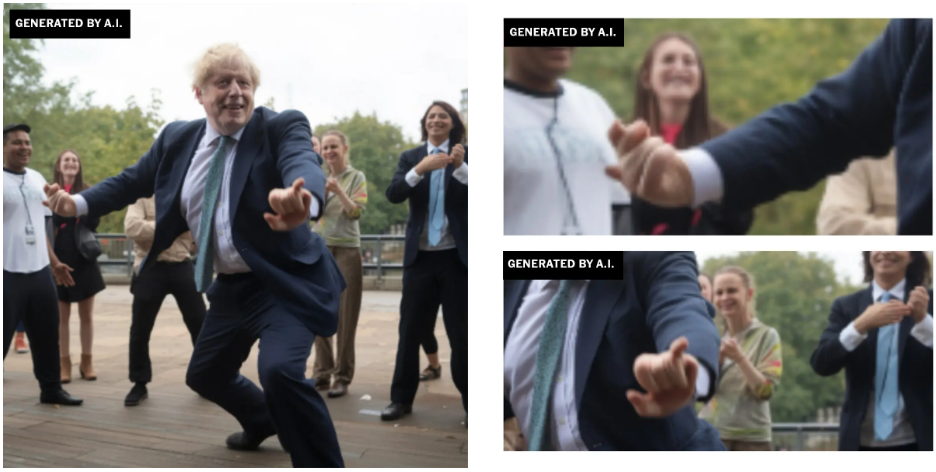

AI góp phần thổi bùng làn sóng thông tin sai sự thật và bị lợi dụng để gây chia rẽ chính trị. Tháng trước, nhiều người bị lừa vì hình ảnh Giáo hoàng Francis mặc áo khoác Balenciaga hay trận động đất tàn phá Tây Bắc Thái Bình Dương. Chúng là tác phẩm của công cụ tạo ảnh AI Midjourney.

Tuần trước, khi cựu Tổng thống Mỹ Donald Trump đến văn phòng luật sư quận Manhattan (Mỹ), hình ảnh do AI tạo ra đã xuất hiện trên diễn đàn Reddit. Một ảnh khác cho thấy ông Trump đang diễu hành trước đám đông lớn với lá cờ Mỹ ở phía sau cũng được chia sẻ rộng rãi trên Twitter mà không kèm chú thích nào.

Các chuyên gia lo ngại công nghệ làm xói mòn lòng tin vào truyền thông, chính phủ và xã hội. Nếu hình ảnh nào cũng tạo ra được và bị thao túng, làm thế nào để duy trì lòng tin vào những gì mắt thấy tai nghe?

Wasim Khaled, CEO Blackbird.AI, công ty giúp khách hàng chống lại tin sai sự thật, nhận xét: “Các công cụ ngày một tốt hơn, rẻ hơn; rồi sẽ đến một ngày, bạn không thể tin được bất kỳ thứ gì trên Internet”.

AI cho phép bất kỳ ai cũng tạo ra được các tác phẩm nghệ thuật phức tạp, chẳng hạn những gì đang triển lãm tại phòng trưng bày Gagosian ở New York, hay những bức ảnh xóa nhòa ranh giới giữa đời thật và ảo. Chỉ cần nhập mô tả, công nghệ sẽ sản xuất ra bức ảnh liên quan, không cần kỹ năng đặc biệt nào.

Thông thường, ảnh do AI tạo ra sẽ có những nhược điểm nhìn ra được. Tuy nhiên, những tiến bộ nhanh chóng đang dần loại bỏ các khiếm khuyết này. Phiên bản Midjourney mới nhất có thể tạo ra ảnh bàn tay chân thực hơn nhiều.

Vài ngày trước khi ông Trump đến Manhattan, hình ảnh về vụ bắt giữ ông đã lan truyền trên mạng xã hội. Chúng được Eliot Higgins, một nhà báo Anh kiêm nhà sáng lập tổ chức điều tra nguồn mở Bellingcat, tạo ra. Ông dùng Midjourney để hình dung về vụ bắt giữ, xét xử, bỏ tù cựu Tổng thống Mỹ rồi đăng ảnh lên Twitter kèm lời giải thích đây chỉ là ảnh giả. Ông không có ý định đánh lừa ai mà chỉ muốn minh họa sức mạnh của công cụ, dù mới ở thời kỳ sơ khai.

Ông cho biết, các hình ảnh của Midjourney có thể vượt qua những chương trình nhận diện gương mặt mà Bellingcat dùng để xác định danh tính mọi người. Dù vậy, nó không tạo ra được hình ảnh chân thật về những người không nổi tiếng như ông Trump.

Sau đó, Midjourney đã đình chỉ tài khoản của Higgins mà không đưa ra lý do.

Trong công cuộc bảo vệ nội dung trước hành vi sử dụng trái phép, các công ty cung cấp ảnh, nhà quản lý và tổ chức thương mại gặp trở ngại do quyền năng của công nghệ. Một số công cụ tạo ảnh AI có thể tái sản xuất hình ảnh của các công ty một cách méo mó.

Tháng 2 năm nay, Getty cáo buộc Stability AI sao chép bất hợp pháp hơn 12 triệu ảnh của mình, cùng chú thích và siêu dữ liệu, để đào tạo phần mềm đứng sau công cụ Stable Diffusion. Theo Getty, hành vi trộm cắp được thực hiện trên quy mô đáng kinh ngạc. Vụ kiện phản ánh lo ngại của các nghệ sĩ về việc bị công ty AI đánh cắp nội dung.

Vi phạm nhãn hiệu cũng là một điều đáng lo ngại. Ảnh do AI tạo ra có thể chèn biểu tượng của các hãng thông tấn hay thương hiệu nổi tiếng. Vào tháng 2, Văn phòng bản quyền Mỹ đánh giá trường hợp của “Zarya of the Dawn”, cuốn truyện tranh 18 trang do Kristina Kashtanova biên soạn và tranh minh họa do Midjourney tạo ra. Cuối cùng, nhà chức trách quyết định cấp bảo hộ cho lời thoại, không cấp cho phần hình ảnh.

Trong khi đó, nguy cơ đối với các nhiếp ảnh gia cũng ngày càng lớn, vượt xa tốc độ phát triển của các biện pháp bảo hộ pháp lý, theo Mickey Osterreicher, Giám đốc pháp lý Hiệp hội nhiếp ảnh gia báo chí quốc gia. Các phòng tin tức ngày càng khó xác thực nội dung, còn người dùng mạng xã hội bỏ qua các nhãn cảnh báo hình ảnh do AI tạo ra, chỉ tin vào những gì họ muốn.

AI tạo sinh giúp cho việc sản xuất video giả mạo dễ dàng hơn. Tuần trước, một video xuất hiện trên mạng cho thấy chuyên gia Nina Schick đang giải thích công nghệ AI tạo sinh. Sau đó, video gặp trục trặc và hiển thị tới hai cơ thể. Video này chính là sản phẩm của AI, do công ty Revel.ai và Truepic tạo ra.

Truepic là một phần của Liên minh nguồn gốc và xác thực nội dung, dự án do các hãng như Adobe, Intel và Microsoft lập ra để truy vết nguồn gốc phương tiện truyền thông tốt hơn. Nvidia cho biết đang hợp tác cùng Getty để đào tạo các mô hình AI “có trách nhiệm”, sử dụng nội dung bản quyền của Getty và trả phí bản quyền cho nghệ sĩ.

Adobe cũng giới thiệu công cụ tạo ảnh riêng, Firefly, được đào tạo bằng các hình ảnh bản quyền hoặc từ kho ảnh riêng hoặc không còn bản quyền. Dana Rao, Giám đốc tin cậy Adobe, chia sẻ công cụ sẽ tự động bổ sung các thông tin nội dung – tương tự nhãn dinh dưỡng cho hình ảnh – để xác định một hình ảnh được tạo ra như thế nào.

(Theo NYT)