CEO Nvidia vừa có mặt trên chương trình “Squawk on the Street” của CNBC. Tại đây, ông tiết lộ giá bán Blackwell, bộ xử lý đồ họa (GPU) dành cho trí tuệ nhân tạo mới nhất của hãng.

“Chúng tôi phải đầu tư một số công nghệ mới cho nó”, ông Huang nói. Ông ước tính Nvidia phải bỏ ra khoảng 10 tỷ USD chi phí nghiên cứu và phát triển Blackwell, cũng như thiết kế các trung tâm dữ liệu và tích hợp nó vào các trung tâm dữ liệu của công ty khác.

Khoảng giá của Blackwell tương đương chip tiền nhiệm H100 hay còn biết đến với tên Hopper, có giá từ 25.000 USD đến 40.000 USD một đơn vị. Hopper ra đời năm 2022 với giá cao hơn đáng kể so với các con chip trước đó của Nvidia.

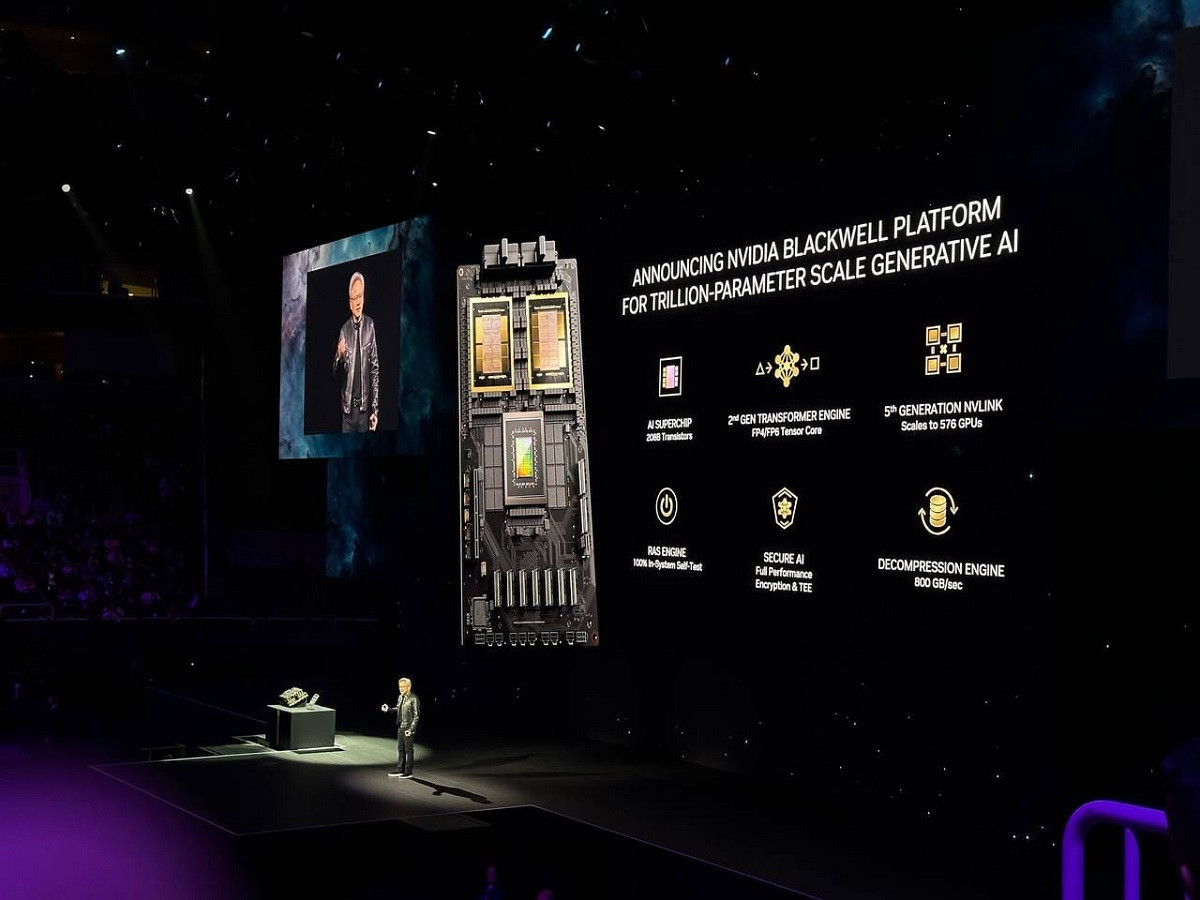

Mỗi hai năm, Nvidia công bố một thế hệ chip AI mới. Blackwell nhanh hơn và tiết kiệm năng lượng hơn so với Hopper. Nó kết hợp hai con chip với nhau và về mặt vật lý cũng lớn hơn hẳn.

Những con chip AI đã giúp Nvidia tăng gấp ba doanh số hằng quý từ khi cơn sốt AI bùng nổ cuối năm 2022. Hầu hết các doanh nghiệp AI hàng đầu hiện nay đều sử dụng chip Nvidia H100 để đào tạo mô hình AI. Chẳng hạn, Meta cho biết đã mua hàng trăm nghìn GPU H100.

Nvidia không công bố giá của chip. Chúng có vài cấu hình khác nhau và mức giá cuối cùng mà Meta hay Microsoft phải trả phụ thuộc vào các yếu tố như số lượng chip mua, khách mua trực tiếp qua Nvidia hay qua một hãng chuyên xây dựng các máy chủ AI như Dell, HP hay Supermicro. Một số máy chủ trang bị khoảng 8 GPU AI.

Hôm 18/3, Nvidia công bố ít nhất ba phiên bản của bộ tăng tốc Blackwell AI – B100, B200 và GB200, kết hợp 2 GPU Blackwell với 1 CPU dựa trên kiến trúc ARM. Chúng khác nhau đôi chút về cấu hình bộ nhớ và dự kiến bán ra cuối năm nay.

(Theo CNBC)